Capítulo 10 ¿Qué es un random forest?

Random Forest, al igual que el árbol de decisión, es un modelo de aprendizaje supervisado para clasificación (aunque también puede usarse para problemas de regresión).

Es una técnica de aprendizaje automático muy popular. Los Random Forests tienen una capacidad de generalización muy alta para muchos problemas.

Los Random Forests se construyen a través de árboles de decisión. Los árboles tienden a aprender muy bien los datos de entrenamiento pero su generalización no es tan buena, por lo tanto tienen la tendencia de sobre-ajustar (overfit). La solución para evitar esto es la de crear muchos árboles y que trabajen en conjunto y estos son los Random Forests.

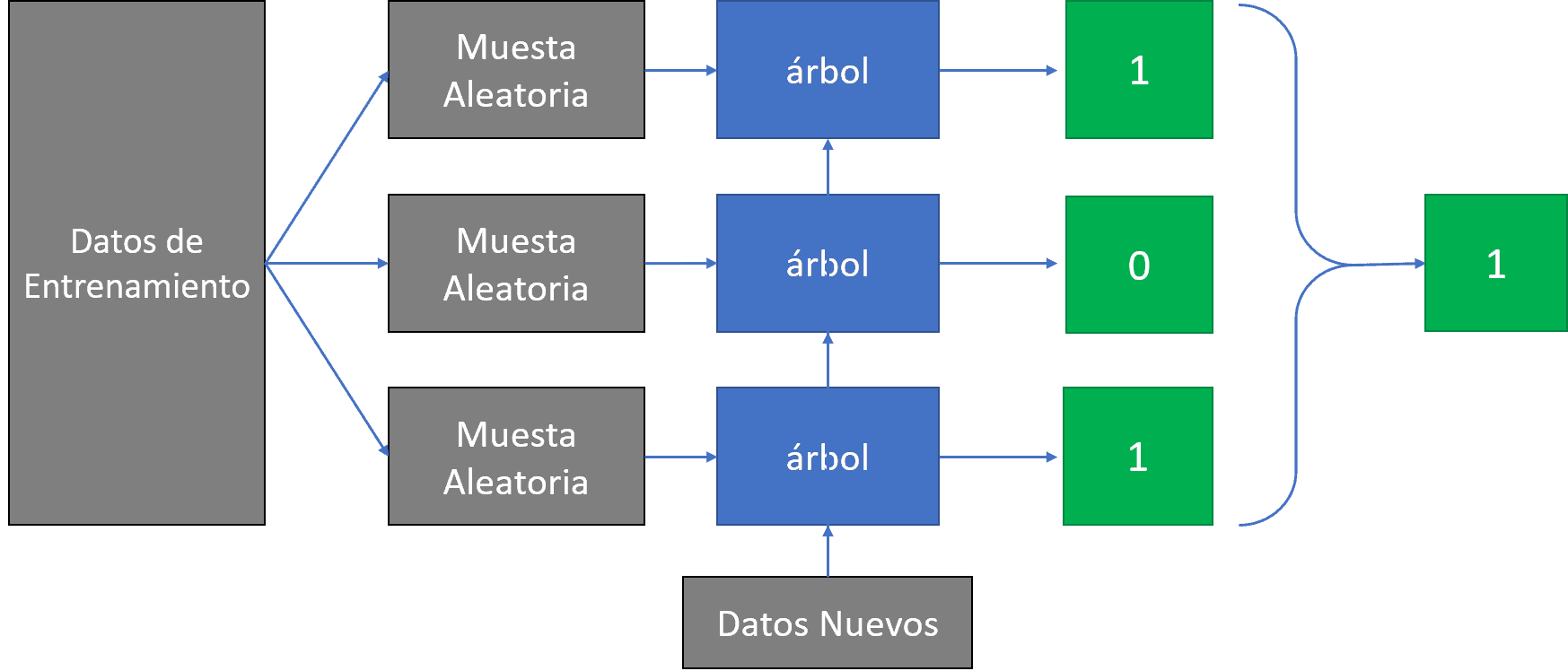

Un Random Forest es un conjunto (ensemble) de árboles de decisión combinados con bagging. Al usar bagging, lo que en realidad está pasando, es que distintos árboles ven distintas porciones de los datos. Ningún árbol ve todos los datos de entrenamiento. Esto hace que cada árbol se entrene con distintas muestras de datos para un mismo problema. De esta forma, al combinar sus resultados, unos errores se compensan con otros y tenemos una predicción que generaliza mejor.

La idea de random forest